Article Information

- Author,Лорі Кларк

- Role,BBC Future

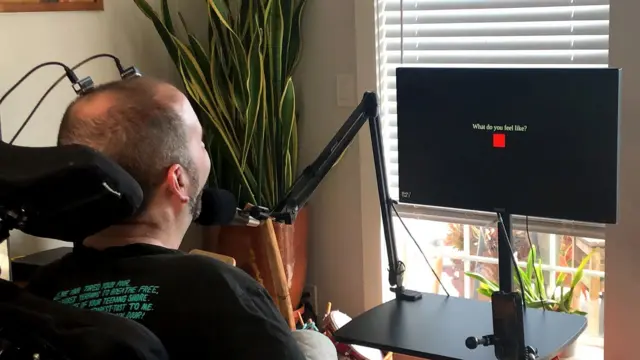

Жінка не рухалася – лише її грудна клітка ритмічно підіймалася й опускалася під час дихання. Її очі були зосереджено спрямовані вперед, а рука стиснута в кулак. На екрані перед нею з’являлися слова, повільно складаючись у цілі речення. Речення, які вона не могла вимовити вголос.

52-річна жінка була паралізована після інсульту 19 років тому, і як наслідок вона була нездатна чітко говорити. Однак тепер її внутрішній монолог з’являвся перед її очима.

Жінці, яку ідентифікували лише як учасницю T16, імплантували крихітний масив електродів у передню частину мозку. Тепер комп’ютер, керований формою штучного інтелекту, розшифровував сигнали від її нейронів, коли вона уявляла, що вимовляє слова, і система перекладала їх у текст на екрані.

Вона брала участь у дослідженні в Стенфордському університеті в Каліфорнії (США) разом із трьома пацієнтами з нейродегенеративним захворюванням бічний аміотрофічний склероз (БАС), метою якого було перевірити методику, здатну перекладати думки в текст у режимі реального часу.

Це – найближче, до чого на цей момент підійшли вчені у “читанні думок”.

Дослідники представили свої результати в серпні 2025 року. Через кілька місяців науковці в Японії продемонстрували метод “транскрибування думок”, здатний створювати детальні та точні описи того, що людина бачить або уявляє у своїй свідомості. Він поєднував три різні інструменти штучного інтелекту з неінвазивним скануванням мозку для перекладу мозкової активності людини.

Обидва дослідження стали останніми в серії проривів, які дають нейробіологам нову можливість зазирнути у внутрішню роботу людського мозку та відкривають можливості допомагати людям, що не можуть спілкуватися іншими способами. У перспективі це може радикально змінити спосіб нашої взаємодії з навколишнім світом і навіть один з одним.

“У найближчі кілька років ми побачимо комерціалізацію цих технологій і їхнє широке впровадження”, – каже Майтреї Вайрагкар, нейроінженерка, яка розробляє нейрокомпʼютерні інтерфейси у лабораторії нейропротезування Каліфорнійського університету в Девісі (США).Skip Найпопулярніше and continue readingНайпопулярніше

На Волині сім авто наздогнали автобус військових ТЦК, скинули на узбіччя та розбили вікна. Деталі інциденту

На Волині сім авто наздогнали автобус військових ТЦК, скинули на узбіччя та розбили вікна. Деталі інциденту Загинув командир 39-ї бригади тактичної авіації Олександр Довгач. Що відомо

Загинув командир 39-ї бригади тактичної авіації Олександр Довгач. Що відомо Україна відправляє спеціалістів для боротьби з іранськими “шахедами” на Близький Схід. Що про це відомо

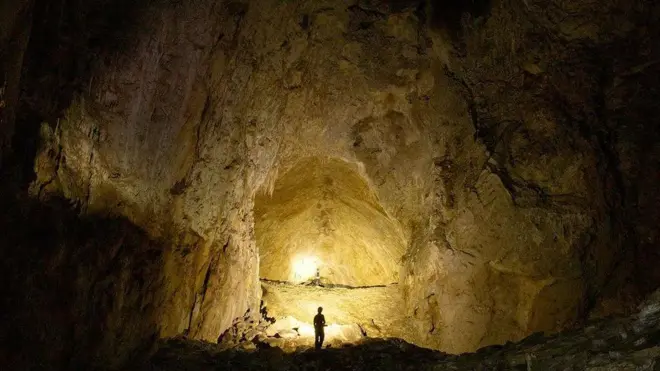

Україна відправляє спеціалістів для боротьби з іранськими “шахедами” на Близький Схід. Що про це відомо Загадкове відкриття в печерах Нью-Мексико змінює уявлення про життя на інших планетах

Загадкове відкриття в печерах Нью-Мексико змінює уявлення про життя на інших планетах

End of Найпопулярніше

Кілька компаній, включно з Neuralink Ілона Маска, вже прагнуть створити комерційні мозкові чипи, які виведуть цю технологію з лабораторій у реальний світ.

“Це дуже захопливо”, – каже Вайрагкар.

Пропустити Whatsapp і продовжити

Як дізнатися головне про Україну та світ?

Підписуйтеся на наш канал тут.

Кінець Whatsapp

Вчені працюють над пристроями, здатними безпосередньо взаємодіяти з людським мозком – відомими як нейрокомпʼютерні інтерфейси (НКІ) – уже дуже довго.

У 1969 році американський нейробіолог Ебергард Фец продемонстрував, що мавпи можуть навчитися рухати стрілку приладу за допомогою активності одного нейрона в мозку, якщо отримують за це харчову винагороду.

У ще більш незвичайному експерименті того ж періоду іспанський науковець Хосе Дельгадо дистанційно стимулював мозок розлюченого бика, змусивши його зупинитися посеред атаки.

Протягом десятиліть НКІ могли розшифровувати сигнали мозку, пов’язані з рухом, щоб користувачі могли керувати протезованою кінцівкою або курсором на екрані. Але інтерфейси, що перекладають сигнали мовлення або інші складні думки, розвивалися повільніше.

“Багато ранніх досліджень проводили на приматах… і, очевидно, з мавпами неможливо вивчати мовлення”, – каже Вайрагкар.

Останніми роками ця галузь досягла вражаючого прогресу в розшифруванні мовлення людей із порушеннями комунікації – наприклад, пацієнтів з БАС, що призводить до паралічу або синдрому “замкненої людини”.

Наприклад, дослідники Стенфордського університету у 2021 році повідомили про успішне дослідження, яке дозволило чоловікові з квадриплегією (паралічем усіх чотирьох кінцівок) створювати речення, уявляючи, що він малює літери в повітрі рукою. За допомогою цього методу він міг писати 18 слів за хвилину.

Природне людське мовлення становить приблизно 150 слів за хвилину, тому наступним етапом стало розшифрування слів із нейронної активності, пов’язаної безпосередньо з мовленням.

У 2024 році лабораторія Вайрагкар випробувала метод, який перекладав спроби мовлення 45-річного чоловіка з БАС безпосередньо в текст на комп’ютерному екрані. Досягнувши приблизно 32 слів за хвилину з точністю 97,5%, це стало першою демонстрацією того, як мовні НКІ можуть допомогти у повсякденному спілкуванні, каже Вайрагкар.

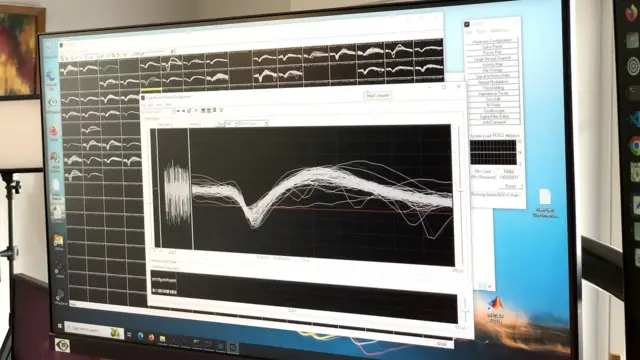

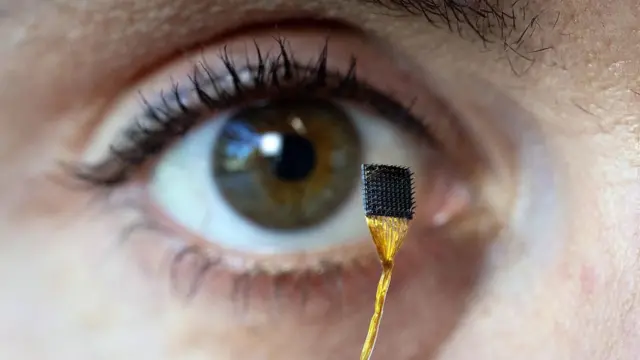

Ці методи ґрунтуються на крихітних “масивах” мікроелектродів, які хірургічно імплантують у поверхню мозку. Масиви записують закономірності нейронної активності з тієї ділянки мозку, де вони розміщені, а сигнали перетворюються на зміст за допомогою комп’ютерного алгоритму.

Саме тут потужність машинного навчання – типу штучного інтелекту – стала вирішальною. Ці алгоритми добре розпізнають закономірності у великих обсягах різнорідних даних. У випадку розшифрування мовлення алгоритми машинного навчання навчають розпізнавати шаблони нейронної активності, пов’язані з різними фонемами – найменшими будівельними елементами мови.

Дослідники порівнюють це з обробкою, яка відбувається в розумних асистентах, таких як Amazon Alexa. Але замість інтерпретації звуків штучний інтелект інтерпретує нейронні сигнали.

Розблокувати внутрішнє мовлення

Попри вражаючі результати останніх спроб розшифрувати мовлення, залишалися певні труднощі. Зазвичай пацієнтам потрібно було намагатися вимовити слова, які вони хотіли передати – навіть якщо вони фізично не могли цього зробити, – щоб технологія нейрокомпʼютерного інтерфейсу змогла точно їх перекласти. Це пов’язано з тим, що електроди зазвичай розміщують у моторній корі – ділянці мозку, відповідальній за рухи м’язів.

Однак спроби говорити потребують зусиль, що робить процес комунікації повільним і виснажливим. У своєму останньому дослідженні вчені зі Стенфордського університету хотіли перевірити, чи є простіший спосіб – чи можна створити метод, який у режимі реального часу фіксуватиме “внутрішнє мовлення” поряд зі “спробами мовлення”.

“Ми просили їх порахувати кількість фігур певного кольору на екрані, тому що припускали, що в такому завданні людина буквально рахуватиме числа у своїй голові”, – каже Френк Віллетт, співкерівник лабораторії трансляційного нейропротезування Стенфордського університету, один з авторів дослідження за участю жінки на початку цієї статті.

“І саме це ми побачили. Ми побачили сліди цих числових слів, що проходили через моторну кору, які змогли зафіксувати”, – додає він.

Відповідь на запитання, чи може ця технологія розпізнавати внутрішнє мовлення, виявилася обережно позитивною. У завданні, пов’язаному з уявленням речення, дослідники досягли точності до 74% у режимі реального часу.

У завданнях, що стимулювали спонтанне внутрішнє мовлення, точність була нижчою, але все ж перевищувала випадковий рівень. Однак у більш відкритих умовах, коли учасникам давали завдання на кшталт “подумайте про свою улюблену цитату з фільму”, розшифрована мова здебільшого була беззмістовною.

“За допомогою сучасних технологій ми поки не можемо ідеально точно отримати повністю нефільтроване внутрішнє мовлення людини, – каже Віллетт. – Але ми змогли досить чітко зафіксувати його сліди в різних завданнях”.

Дослідження також допомогло краще зрозуміти, як працює внутрішнє мовлення в мозку. Воно встановило, що нейронні патерни внутрішнього мовлення тісно пов’язані з патернами спроб мовлення в моторній корі, але сигнали при цьому слабші.

Це узгоджується з попередніми нейровізуалізаційними та електрофізіологічними дослідженнями, які показали, що внутрішнє мовлення залучає мережу мозку, подібну до тієї, що використовується під час реального мовлення.

За межами слів

Лабораторія Вайрагкар у Каліфорнійському університеті в Девісі досягла прориву у 2025 році, коли продемонструвала, що може розшифровувати не лише слова, а й невербальні компоненти мовлення — інтонацію, висоту тону, швидкість і ритм. Фактично це дозволило пацієнтам передавати емоційність і наголос, а не лише сам текст.

“Людське мовлення – це значно більше, ніж текст на екрані, – каже Вайрагкар. – Більша частина нашого спілкування полягає в тому, як ми говоримо, як виражаємо себе; те, що ми говоримо, має різні значення залежно від контексту”.

Вайрагкар і її колеги показали, що їхній прототип може відтворювати мовлення вголос у той момент, коли пацієнт з БАС із тяжким порушенням моторики мовлення намагається говорити.

Важливо, що учасник міг змінювати інтонацію, щоб передати зміст.

“Наш учасник міг ставити запитання з підвищенням тону в кінці речення і змінювати висоту голосу під час мовлення, – каже Вайрагкар. – Ми продемонстрували це в простому завданні, коли він наспівував мелодії”.

Результати були неідеальними, але 60% слів тестувальники визнали зрозумілими. Хоча це все ще поступається найкращим технологіям “мозок-текст”, експеримент показав, що може стати можливим найближчим часом.

І Вайрагкар, і Віллетт вважають, що подальший прогрес неминучий. Один зі шляхів покращення – просто збільшити кількість мікроелектродів, розміщених у мозку.

“У нашому мозку є мільярди нейронів і трильйони зв’язків”, – каже Вайрагкар.

У її останньому дослідженні аналізували лише 256 із них, каже науковиця.

“Новіші пристрої та кращі технології зможуть охоплювати більше нейронів, отримувати багатшу інформацію та досягати зрозумілого мовлення в реальному часі”, – додає вона.

Віллетт особливо зацікавлений у подальшому вивченні внутрішнього мовлення та планує дослідити, як інші ділянки мозку, окрім моторної кори, можуть бути у нього залучені.

“Одна з областей, яка нас цікавить, – це верхня скронева звивина”, — каже він, маючи на увазі ділянку мозку, пов’язану зі слуховою обробкою, яка також може відігравати роль у внутрішньому мовленні, наприклад, у слухових уявленнях того, що ви чуєте у своїй голові.

Вихід за межі моторної кори може бути важливим і для допомоги людям з ураженнями цієї ділянки мозку – наприклад, жертвам інсульту, у яких моторна кора пошкоджена, але які все ще можуть розуміти мовлення.

Виявлення інших ділянок мозку, залучених у внутрішнє мовлення, одного дня може допомогти і цим людям спілкуватися, каже Віллетт.

Побачити – значить повірити

Поки дослідники нейрокомпʼютерних інтерфейсів зосереджені на практичному застосуванні технології для допомоги пацієнтам, інші галузі також досягають прогресу в розшифруванні сканів мозку та глибшому розумінні його роботи.

Один із напрямів полягає у відтворенні зображень, які бачила людина, лише шляхом аналізу сканування мозку за допомогою штучного інтелекту.

Це працює так: учасникам показують зображення, поки їхню мозкову активність записують за допомогою функціональної магнітно-резонансної томографії (фМРТ) – методу, що вимірює активність мозку, фіксуючи зміни кровотоку в різних його ділянках. Потім нейронні дані розшифровує алгоритм і передає їх генератору зображень на основі ШІ, який намагається відтворити те, що бачив учасник.

Дослідники намагаються розв’язати цю задачу десятиліттями, але бум генеративного ШІ останніх років дав галузі потужний імпульс. Новітні генератори зображень, такі як Stable Diffusion, значно підвищили якість створюваних зображень.

Ю Такагі, доцент Нагойського технологічного інституту в Японії, опублікував у 2023 році дослідження за цим методом із використанням алгоритму Stable Diffusion.

Алгоритм навчали на онлайн-наборі даних, створеному Університетом Міннесоти, що складався зі сканів мозку чотирьох учасників під час перегляду кожним із них 10 000 фотографій. У багатьох випадках ШІ зміг відтворити прийнятне наближення до оригінального зображення – хоча повністю “завис” на мисці з салатом.

Нині ця галузь розвивається швидко. Дослідження, опубліковане торік ізраїльськими науковцями, дозволило відтворити ще точніші зображення.

Такі роботи допомогли краще зрозуміти, як мозок обробляє візуальну інформацію, каже Такагі. Виявилося, що вирішальну роль відіграють дві різні ділянки мозку.

Потилична частка, розташована в задній частині мозку, кодує “низькорівневі” візуальні характеристики зображення – такі як розташування, перспектива та колір. Натомість скронева частка, розташована позаду скронь, кодує “високорівневі” концептуальні елементи, пов’язані з класифікацією того, що саме являє собою об’єкт.

Звуки музики

Тривають також спроби відтворювати слухові переживання. У 2025 році Такагі опублікував дослідження, у якому використовував пропрієтарний алгоритм Google, щоб спробувати відтворити аудіо зі сканів фМРТ, зроблених під час прослуховування учасниками музичних творів.

За словами Такагі, це складніше, ніж реконструювати візуальні стимули, оскільки музика постійно змінюється, тоді як фМРТ-сканер виконує знімки лише з інтервалом в одну секунду.

“Якість реконструкції нижча порівняно з відтворенням зображень, – каже він. – Але нам усе ж вдалося відтворити характер музики та її базову категорію”.

Ця галузь поглибила наше розуміння нейронних основ сприйняття музики.

“Нас у цьому дослідженні здивувало те, що сприйняття музики в мозку відрізняється від сприйняття зображень”, – каже Такагі.

“Для зображень високорівнева та низькорівнева інформація мають окремі локалізації в мозку. Для музики ми виявили, що семантика та низькорівнева інформація не розділені”, – пояснює він.

Такагі захоплений потенційними застосуваннями цих підходів. За його словами, можна було б відтворювати слухові й зорові галюцинації психіатричних пацієнтів, наприклад людей із шизофренією, щоб краще зрозуміти їхній стан.

Ці методи також можна використати для реконструкції того, як сприймають світ тварини, або навіть для відтворення снів.

“Багато людей запитують про це”, – сміється Такагі.

Він каже, що хотів би одного дня відтворювати сни, але наразі це надзвичайно складно. Деякі дослідження навіть порушують питання прямої комунікації “мозок-мозок”, зокрема між кількома людьми одночасно, хоча етичні наслідки та питання прав людини, пов’язані з такими пристроями, ще належить повністю осмислити.

Тим, хто сподівається, що незабаром стане можливим стимулювати зорові або слухові переживання в мозку задля розваг, Такагі радить запастися терпінням. Хоча теоретично це можливо, через технічні обмеження цього, ймовірно, не станеться ще протягом 10–20 років.